Une proposition de loi examinée au Sénat le 8 avril instaure une présomption d'exploitation des contenus culturels par les fournisseurs d'IA. Un mécanisme qui doit inverser la charge de la preuve et cible les géants américains réfugiés derrière le "fair use". La semaine même où la Maison Blanche publiait sa feuille de route IA, deux conceptions du rapport entre création et machine s'affrontent ouvertement.

Déposée le 12 décembre 2025 par six sénatrices et sénateurs, parmi lesquels Laure Darcos, rapporteure du texte, Agnès Evren et Pierre Ouzoulias, la proposition de loi relative à la présomption d’exploitation des contenus culturels franchit une étape de plus. Examinée en commission de la culture le 1er avril, elle a été votée par le Sénat en séance publique le 8 avril dernier. Son ambition : contraindre les acteurs de l’IA générative à rémunérer les auteurs, éditeurs, musiciens et autres titulaires de droits dont les œuvres alimentent leurs modèles. Le texte est désormais dans les mains de l’Assemblée Nationale qui doit l’examiner au sein de la commission des affaires culturelles et de l’éducation.

Ce que “présomption d’exploitation” signifie et pourquoi ça change tout

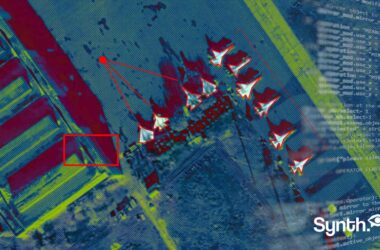

Le cœur du dispositif porté par le texte tient en un renversement de preuve. Jusqu’ici, c’est au créateur de contenu de prouver que son œuvre a été ingérée dans un corpus d’entraînement. Une démarche quasi impossible face à des jeux de données opaques détenu par des géants de la tech américaine, peu enclins à ouvrir les portes de leurs IA. La proposition de loi inverse cette logique : les fournisseurs d’IA seront présumés exploitant de contenus protégés et ce sera à eux de démontrer le contraire.

L’avis du Conseil d’État, rendu public le 23 mars 2026, dissipe d’ailleurs les doutes juridiques. La présomption est conforme à la Constitution et compatible avec le droit européen, le législateur national conservant, au titre de l’autonomie procédurale des États membres, la liberté d’instaurer un mécanisme probatoire. Surtout, la loi s’applique à tous les fournisseurs commercialisant des IA génératives en France, quel que soit leur lieu d’établissement. Les acteurs américains comme OpenAI, Anthropic ou Google sont donc expressément visés.

Le “fair use” comme bouclier : anatomie d’une stratégie d’évitement

Les acteurs américains de l’IA qui dominent le marché ont systématiquement et opportunément invoqué le principe de “fair use” pour échapper à tout accord les contraignant à rémunérer les auteurs d’œuvres protégées. On le rappelle, le fair use (ou droit de fouille) autorise certains usages d’œuvres protégées lorsqu’ils servent des fins transformatives. Ce principe n’a jamais été pensé pour le scraping massif, mais il a longtemps suffi à bloquer toute négociation contraignante.

En Europe, ce bouclier en tous cas ne tient pas : la directive sur le droit d’auteur de 2019 encadre l’exception de fouille de données et permet aux titulaires de droits de s’y opposer. Mais l’effectivité de ce droit reste théorique tant que la transparence sur les données utilisées fait défaut. Les concertations menées entre les titulaires de droits et les fournisseurs d’IA n’ayant pas permis de parvenir à une solution partagée, le Sénat a estimé que seule une contrainte législative pouvait rendre crédible l’émergence d’un marché de licences volontaires.

Washington déréglemente, Paris réglemente: une même semaine, deux visions antagonistes

Le 20 mars 2026, la Maison Blanche a dévoilé sa politique IA destinée au Congrès. Le document exhorte les législateurs à prendre la main sur les réglementations des États fédérés, à simplifier les procédures d’autorisation pour les centres de données et à accélérer le déploiement de l’IA dans tous les secteurs, dans le but d’assurer une domination mondiale américaine. Sur la propriété intellectuelle, la position est délibérément attentiste : laisser les tribunaux définir les règles plutôt que légiférer, tout en préparant des outils de protection contre les deepfakes sans bloquer l’innovation.

Le contraste avec la démarche sénatoriale française est net. D’un côté, une logique de puissance qui présuppose que la valeur produite par l’IA justifie de différer les questions de redistribution. De l’autre, une tentative de poser dès maintenant les conditions d’un partage. Ce que cette confrontation de points de vue révèle, au fond, c’est moins un désaccord technique sur le droit d’auteur qu’une divergence culturelle profonde sur ce que l’IA doit à la culture qui l’a nourrie, et sur qui a le droit de poser cette question.

Soutenez Synth

Soutenez Synth

CET ARTICLE EST DISPONIBLE POUR TOUTES ET TOUS

Face à la domination des GAFAM et de leurs algorithmes opaques, nous vous aidons à reprendre la main sur les récits technologiques qui façonnent notre quotidien.

En soutenant Synth, vous co-construisez une voix forte, libre et indépendante. Vous pouvez faire un don à partir de 1€

Contribuez dès aujourd’hui avec un don défiscalisé à 66 %.

Chaque euro compte, et un engagement mensuel multiplie l’impact.